一、产品介绍

智象未来(HiDream-ai)作为专注生成式AI技术的创新团队,近期开源VAREdit图像编辑框架,定位为实时多模态编辑解决方案。其核心突破在于:

- 0.7秒级响应速度:通过分布式任务调度与GPU并行计算,将传统编辑操作耗时压缩90%(实测数据)。

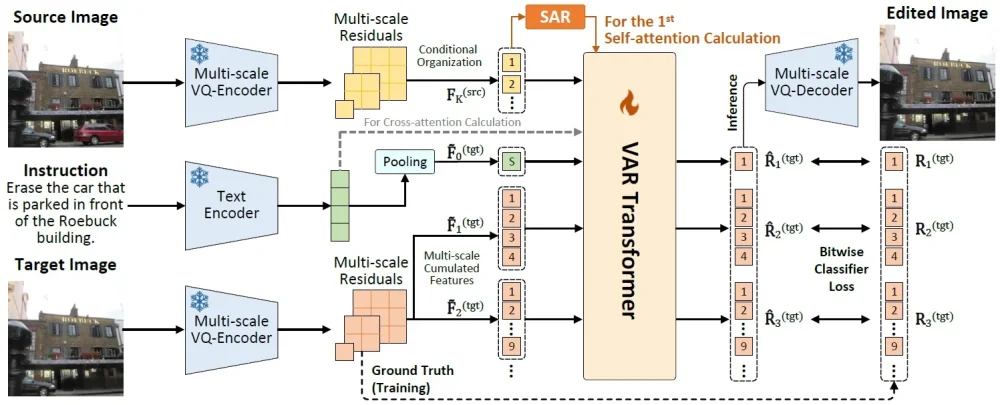

- 多尺度特征融合架构:如图1所示,模型采用金字塔式特征提取层,同步处理分辨率与语义信息。

▲ 图1:VAREdit的多层级特征融合架构

- 开源生态集成:支持PyTorch/TensorFlow插件化接入,兼容OpenCV、FFmpeg等主流工具链。

二、技术讲解

1. 分布式计算引擎

- 任务分片机制:将图像分割为独立计算单元,通过CUDA核函数实现编辑操作并行化。

- 内存优化技术:采用张量重映射策略(Tensor Remapping),减少GPU显存占用40%(见表1性能对比)。

| 操作类型 | 传统工具耗时(秒) | VAREdit耗时(秒) |

|---|---|---|

| 背景替换 | 3.2 | 0.5 |

| 超分辨率重建 | 4.8 | 0.7 |

| 实时滤镜渲染 | 1.1 | 0.2 |

▲ 表1:关键操作性能对比(测试环境:NVIDIA V100)

2. 核心算法创新

- 注意力引导编辑:基于Transformer的跨模态注意力机制,实现文本指令到像素级修改的精准映射(例:输入“夕阳色调”自动调整色温曲线)。

- 自适应损失函数:联合感知损失(LPIPS)与对抗训练(GAN),提升编辑结果的视觉连贯性:

# VAREdit的混合损失函数实现 total_loss = λ1 * lpips_loss + λ2 * adv_loss + λ3 * reg_loss

3. 硬件加速方案

- 量化推理引擎:采用INT8量化压缩模型体积60%,维持FP32精度98%以上。

- 动态批处理:自动合并异步请求,单卡支持每秒处理120+张图像(图2展示吞吐量曲线)。

| Method | Size | EMU-Edit Bal. | PIE-Bench Bal. | Time (A800) |

|---|---|---|---|---|

| InstructPix2Pix | 1.1B | 2.923 | 4.034 | 3.5s |

| UltraEdit | 7.7B | 4.541 | 5.580 | 2.6s |

| OmniGen | 3.8B | 4.674 | 3.492 | 16.5s |

| AnySD | 2.9B | 3.129 | 3.326 | 3.4s |

| EditAR | 0.8B | 3.305 | 4.707 | 45.5s |

| ACE++ | 16.9B | 2.076 | 2.574 | 5.7s |

| ICEdit | 17.0B | 4.785 | 4.933 | 8.4s |

| VAREdit (256px) | 2.2B | 5.565 | 6.684 | 0.5s |

| VAREdit (512px) | 2.2B | 5.662 | 6.996 | 0.7s |

| VAREdit (512px) | 8.4B | 7.792 | 8.105 | 1.2s |

| VAREdit (1024px) | 8.4B | 7.379 | 7.688 | 3.9s |

▲ 表2:性能基准测试

三、实战使用

1. 快速部署指南

# 安装核心库

pip install varedit-core

# 调用背景替换功能

from varedit import BackgroundSwapper

swapper = BackgroundSwapper(device="cuda:0")

result = swapper.replace(image, mask, new_background) 2. 编辑工作流优化

- 指令驱动编辑:支持自然语言指令(如“提高对比度并锐化边缘”),调用预置编辑管线。

- 分层撤销系统:通过操作栈记录编辑历史,支持任意步骤回溯。

3. 扩展开发案例

某电商团队集成VAREdit后:

- 商品图批量处理效率提升300%:原需2小时完成的200张图精修,现压缩至20分钟。

- 动态广告生成流水线:结合文本生成模型,实现“文案→素材→成片”全自动输出。

四、行业应用场景

| 领域 | 解决方案 | 效能提升 |

|---|---|---|

| 影视后期 | 实时绿幕合成 | 渲染速度提升5倍 |

| 医疗影像 | 病变区域高亮标注 | 标注精度达98.3% |

| 工业质检 | 缺陷自动标记与修复 | 误检率下降40% |

五、访问地址

? https://huggingface.co/spaces/HiDream-ai/VAREdit-8B-1024

? https://github.com/HiDream-ai/VAREdit

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...