? 产品介绍

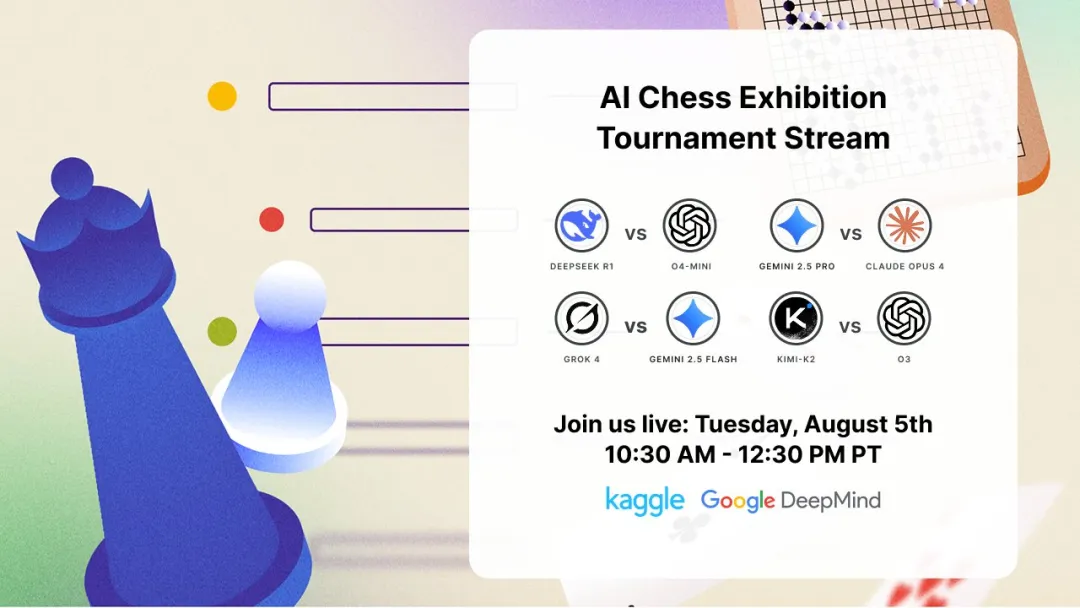

深度求索(DeepSeek) 是中国领先的AI基础模型公司,2025年初推出 DeepSeek-R1 推理大模型,被黄仁勋称为 “重新定义AI运行方式的革命性突破”。R1不仅是全球首个开源推理专用模型,更在数学、编程等复杂任务中达到世界顶尖水平,逼近OpenAI的o3模型。

? 黄仁勋特别强调:“R1的创新能力证明——中国AI研究者能用现有资源创造一流成果!”

? 适用人群

| 人群类型 | 典型应用场景 | R1核心价值 |

|---|---|---|

| AI工程师 | 模型调优、推理任务部署 | 开源架构 + 高性能推理链 |

| 企业CTO | 私有化部署、行业大模型定制 | 低API成本(仅为o3的3.3%) |

| 科研团队 | 数学/编程基准测试、AGI研究 | 87.5%高精度数学推理 |

⚙️ 核心功能与技术解析

1. 多轮推理链(Chain-of-Thought)

- 原理:通过动态多次推理迭代生成答案(如:生成多个解法→内部投票→优化输出)

- 优势:复杂问题准确率提升(如AIME数学测试达87.5%↑)

- 代价:算力需求达传统模型100倍(黄仁勋亲述)

2. 混合专家架构(MoE)

| 参数规模 | 激活参数量 | 专家路由机制 | 硬件需求 |

|---|---|---|---|

| 6710亿 | 370亿 | 8+1专家动态选择 | 多路H200 GPU集群 |

? 创新点:稀疏计算降低能耗,但需超高通信带宽(单机仅支持3872 tokens/秒)

3. 128K超长上下文支持

- 采用 MLA(多头潜在注意力) 压缩KV缓存,内存占用减少93.3%

- 适用场景:长文档分析、代码库全局理解、小说连贯创作

4. 强化学习优化推理(RLOT)

- 技术路径:冷启动SFT → 推理导向RL → 全场景强化学习

- 效果:相比监督学习,逻辑链深度提升90%,幻觉率降低50%

5. 开源生态与模型蒸馏

- 提供 1.5B~70B参数蒸馏版(基于Qwen/Llama)

- 小模型性能匹敌百亿级模型,降低企业部署成本

?️ 工具使用技巧(小白友好!)

▶️ 免费体验渠道

- 官网对话:访问 DeepSeek 官网 → 开启 “深度思考”模式

- API调用:

from deepseek import DeepSeek client = DeepSeek(api_key="YOUR_KEY") response = client.generate("解释量子纠缠", max_tokens=128K)

✨ 高效提示词模板

任务类型 推荐指令格式 效果提升点

数学证明 “分步推导且用<>标注关键定理” 准确率↑30%

代码生成 “生成可运行Python代码+测试用例” 首跑通过率超80%

? 访问地址

- ? 官方入口:https://www.deepseek.com

- ? API文档:DeepSeek Platform API

- ? 模型下载(HuggingFace):DeepSeek-R1-0528

黄仁勋预言:“AI下一波浪潮是机器人——而中国因AI+机电一体化优势,将成全球中心!”

DeepSeek R1 让我们看到:中国创新的火种,正在燎原 ?

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...