? 产品介绍

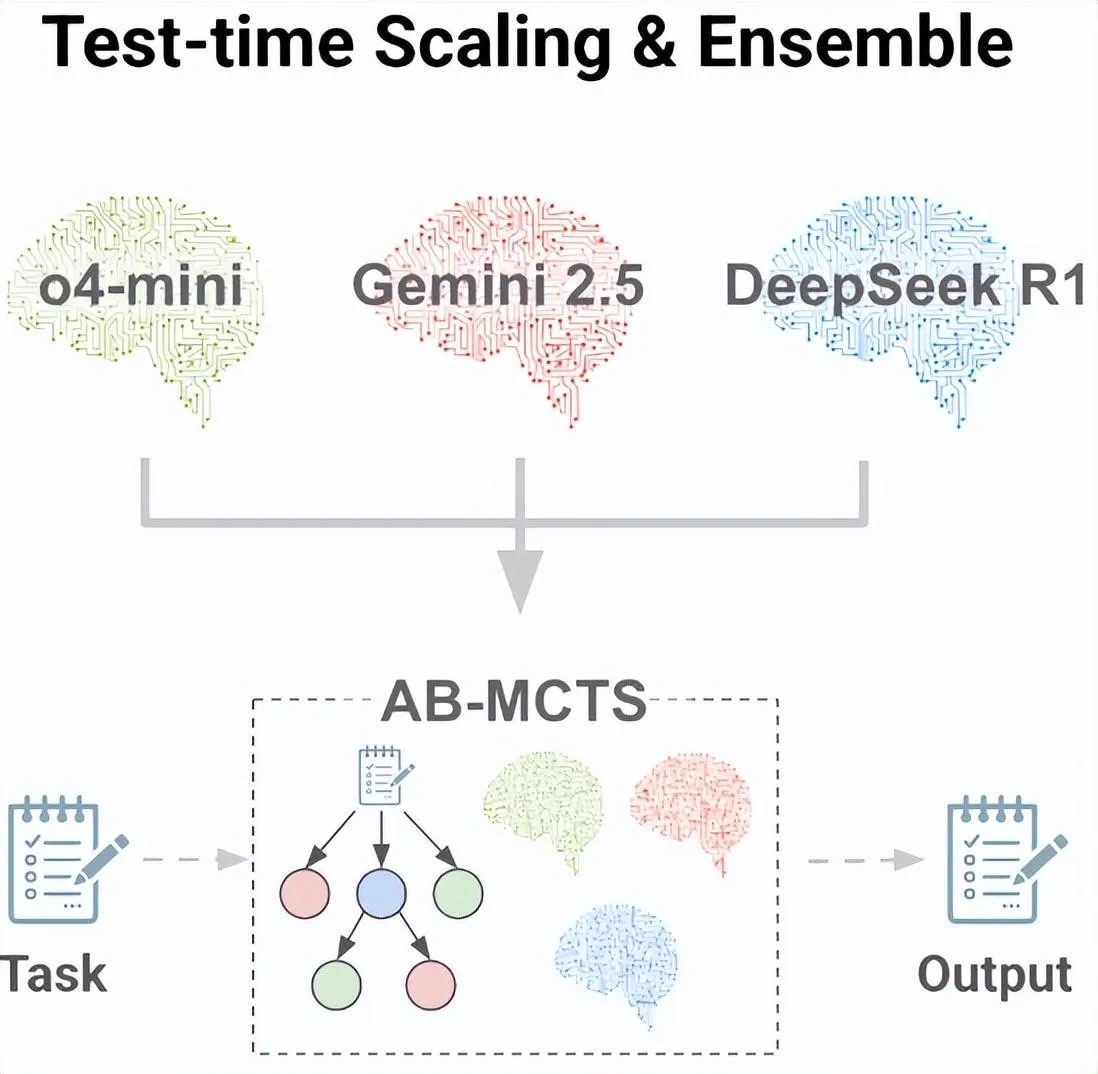

Sakana AI 是由Transformer架构创始人之一 Llion Jones 创立的日本AI实验室,专注于通过进化算法和集体智能开发下一代AI系统。2025年7月,其发布 TreeQuest 开源框架,首次实现 OpenAI o4-mini、Google Gemini 2.5 Pro、DeepSeek-R1-0528 三大模型的动态协作,在复杂任务中表现惊艳。

? 核心突破:

三大模型不再是“单兵作战”,而是通过 Multi-LLM AB-MCTS算法(自适应分支蒙特卡洛树搜索)形成“AI梦之队”,在逻辑推理、错误修正、跨领域任务中互补短板,解决单一模型无法攻克的难题。

? 适用人群

| 用户类型 | 需求场景 |

|---|---|

| AI研究员 | 探索多模型协作机制与推理时扩展(Inference-Time Scaling)技术 |

| 企业技术负责人 | 构建高可靠性AI系统,避免依赖单一供应商模型 |

| 开发者 | 通过开源框架快速集成多模型API,优化复杂任务处理流程 |

⚙️ 核心功能与技术解析

1. 自适应多模型协作(Multi-LLM Orchestration)

- 技术原理:

采用 AB-MCTS算法,动态分配任务给最合适的模型:

✅ 深度搜索:优化现有方案(如由Gemini分析代码漏洞后,DeepSeek迭代修复)

✅ 广度搜索:生成全新方案(如o4-mini提供创意框架,Gemini补充细节)

系统初期平衡调用各模型,后期基于表现加权分配任务,实现计算资源高效利用。

2. 集体纠错与推理增强

- 技术原理:

当某模型输出错误(如o4-mini生成幻觉答案),系统自动将结果传递给其他模型交叉验证。DeepSeek-R1擅长逻辑验证,Gemini长于多模态关联,协同修正最终答案。? 实测案例:

在ARC-AGI-2视觉推理测试中,单模型正确率≤22%,而三模型协作正确率跃升至30%+。

3. 零训练成本模型融合

- 技术原理:

基于Sakana早前进化模型融合技术(Evolutionary Model Merge),无需重新训练即可组合异构模型能力。例如将日语LLM与数学专用LLM合并,生成具备文化语境的高精度数学推理模型。

4. 企业级动态模型池

- 技术原理:

支持企业自定义模型组合(如Claude + 国产大模型),通过TreeQuest的API动态分配子任务。例如客户服务场景:创意问题分配o4-mini,技术问题分配DeepSeek,多语言需求分配Gemini。

?️ 工具使用技巧

- 灵活定义评分逻辑:

在API中设置自定义评估函数(如代码正确性、文化适配度),引导AB-MCTS精准筛选方案。 - 检查点恢复机制:

任务中断时可从最近节点重启,避免百步推理推倒重来。 - 混合部署降低成本:

对非关键任务调用轻量模型(如o4-mini),复杂环节启用高价模型(如Gemini 2.5 Pro)。

? 访问地址

- GitHub开源库:

https://github.com/sakanaai/treequest(Apache 2.0许可,支持商用) - 在线Demo:

Hugging Face Spaces体验三模型协作解谜 - 技术白皮书:

Sakana官网博客详解AB-MCTS算法设计

? 开发者说:

“这不再是‘三个模型干活’,而是让AI学会组建自己的复仇者联盟!” —— Llion Jones, Sakana AI联合创始人

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...